Teorema di Chebyshov cos'è, applicazioni ed esempi

Il Teorema di Chebyshov (o la disuguaglianza di Chebyshov) è uno dei risultati classici più importanti della teoria della probabilità. Permette di stimare la probabilità di un evento descritto in termini di variabile casuale X, fornendoci un limite che non dipende dalla distribuzione della variabile casuale ma dalla varianza di X.

Il teorema prende il nome dal matematico russo Pafnuty Chebyshov (scritto anche come Chebychev o Tchebycheff) che, pur non essendo il primo ad affermare il teorema, fu il primo a dare una dimostrazione nel 1867.

Questa disuguaglianza, o quelle che per le loro caratteristiche sono chiamate disuguaglianza di Chebyshov, vengono utilizzate principalmente per approssimare le probabilità calcolando i limiti.

Indice articolo

- 1 Cosa fa?

- 2 Applicazioni ed esempi

- 2.1 Limitazione delle probabilità

- 2.2 Dimostrazione dei teoremi limite

- 2.3 Dimensione del campione

- 3 Disuguaglianze di tipo Chebyshov

- 4 Riferimenti

In cosa consiste?

Nello studio della teoria della probabilità accade che se la funzione di distribuzione di una variabile casuale X è nota, se ne possono calcolare il valore atteso o l'aspettativa matematica E (X) e la sua varianza Var (X), purché tali importi esistano . Tuttavia, il contrario non è necessariamente vero..

Cioè, conoscendo E (X) e Var (X) non è necessariamente possibile ottenere la funzione di distribuzione di X, quindi quantità come P (| X |> k) per qualche k> 0 sono molto difficili da ottenere. Ma grazie alla disuguaglianza di Chebyshov è possibile stimare la probabilità della variabile casuale.

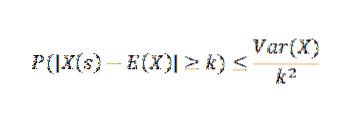

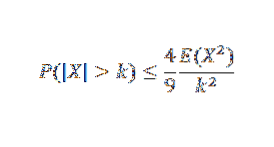

Il teorema di Chebyshov ci dice che se abbiamo una variabile casuale X su uno spazio campionario S con una funzione di probabilità p, e se k> 0, allora:

Applicazioni ed esempi

Tra le molte applicazioni del teorema di Chebyshov, si possono menzionare le seguenti:

Probabilità limitanti

Questa è l'applicazione più comune e viene utilizzata per dare un limite superiore per P (| X-E (X) | ≥k) dove k> 0, solo con la varianza e l'aspettativa della variabile casuale X, senza conoscere la funzione di probabilità.

Esempio 1

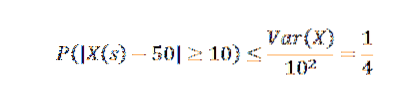

Supponiamo che il numero di prodotti fabbricati in un'azienda durante una settimana sia una variabile casuale con una media di 50.

Se è noto che la varianza di una settimana di produzione è pari a 25, allora cosa possiamo dire della probabilità che questa settimana la produzione differisca di oltre 10 dalla media?

Soluzione

Applicando la disuguaglianza di Chebyshov abbiamo:

Da ciò si ricava che la probabilità che nella settimana di produzione il numero di articoli superi la media di oltre 10 è al massimo 1/4.

Teoremi di dimostrazione del limite

La disuguaglianza di Chebyshov gioca un ruolo importante nel dimostrare i teoremi limite più importanti. A titolo di esempio abbiamo quanto segue:

Legge debole dei grandi numeri

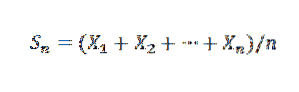

Questa legge stabilisce che data una successione X1, X2,…, Xn,… di variabili casuali indipendenti con la stessa distribuzione media E (Xi) = μ e varianza Var (X) = σDue, e un campione medio noto di:

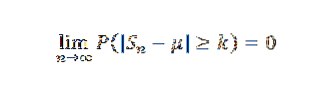

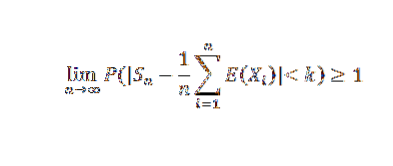

Allora per k> 0 abbiamo:

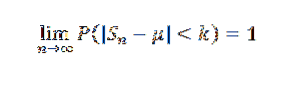

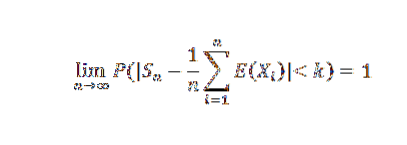

Oppure, equivalentemente:

Dimostrazione

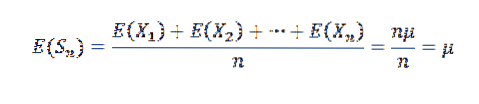

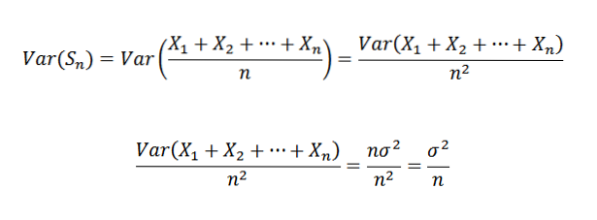

Notiamo innanzitutto quanto segue:

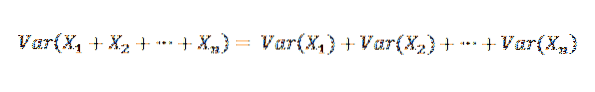

Poiché X1, X2, ..., Xn sono indipendenti, ne consegue che:

È quindi possibile affermare quanto segue:

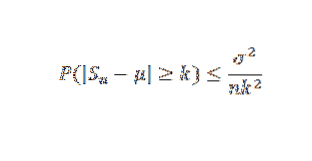

Quindi, usando il teorema di Chebyshov, abbiamo:

Infine, il teorema risulta dal fatto che il limite a destra è zero quando n tende all'infinito.

Va notato che questo test è stato fatto solo per il caso in cui esiste la varianza di Xi; cioè, non diverge. Quindi osserviamo che il teorema è sempre vero se esiste E (Xi).

Teorema del limite di Chebyshov

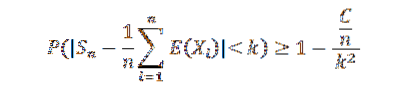

Se X1, X2,…, Xn,… è una sequenza di variabili casuali indipendenti tale che ci sia del C< infinito, tal que Var(Xn) ≤ C para todo n natural, entonces para cualquier k>0:

Dimostrazione

Poiché la successione delle varianze è limitata in modo uniforme, abbiamo che Var (Sn) ≤ C / n, per tutti gli n naturali. Ma sappiamo che:

Facendo tendere n all'infinito, si ottengono i seguenti risultati:

Poiché una probabilità non può superare il valore di 1, si ottiene il risultato desiderato. Come conseguenza di questo teorema potremmo citare il caso particolare di Bernoulli.

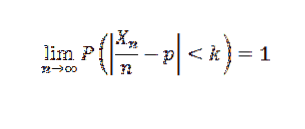

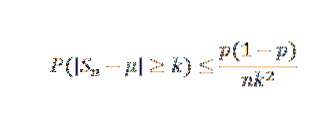

Se un esperimento viene ripetuto n volte indipendentemente con due possibili risultati (fallimento e successo), dove p è la probabilità di successo in ogni esperimento e X è la variabile casuale che rappresenta il numero di successi ottenuti, allora per ogni k> 0 hai per:

Misura di prova

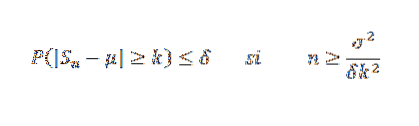

In termini di varianza, la disuguaglianza di Chebyshov ci consente di trovare una dimensione campionaria n sufficiente a garantire che la probabilità che si verifichi | Sn-μ |> = k sia piccola quanto desiderata, il che ci consente di avere un'approssimazione della media.

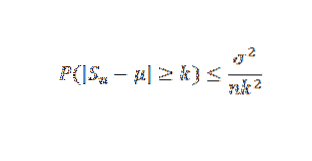

Precisamente, siano X1, X2,… Xn un campione di variabili casuali indipendenti di dimensione ne supponiamo che E (Xi) = μ e la sua varianza σDue. Quindi, dalla disuguaglianza di Chebyshov abbiamo:

Esempio

Supponiamo che X1, X2,… Xn siano un campione di variabili casuali indipendenti con distribuzione di Bernoulli, tali che assumano il valore 1 con probabilità p = 0,5.

Quale dovrebbe essere la dimensione del campione per poter garantire che la probabilità che la differenza tra la media aritmetica Sn e il suo valore atteso (superiore di più di 0,1), sia minore o uguale a 0., 01?

Soluzione

Abbiamo che E (X) = μ = p = 0,5 e che Var (X) = σDue= p (1-p) = 0,25. In base alla disuguaglianza di Chebyshov, per ogni k> 0 abbiamo:

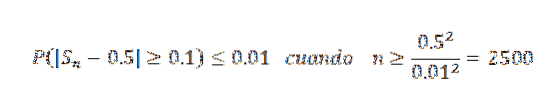

Ora, prendendo k = 0,1 e δ = 0,01, abbiamo:

In questo modo, si conclude che è necessaria una dimensione del campione di almeno 2500 per garantire che la probabilità dell'evento | Sn - 0,5 |> = 0,1 sia inferiore a 0,01.

Disuguaglianze di tipo Chebyshov

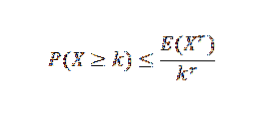

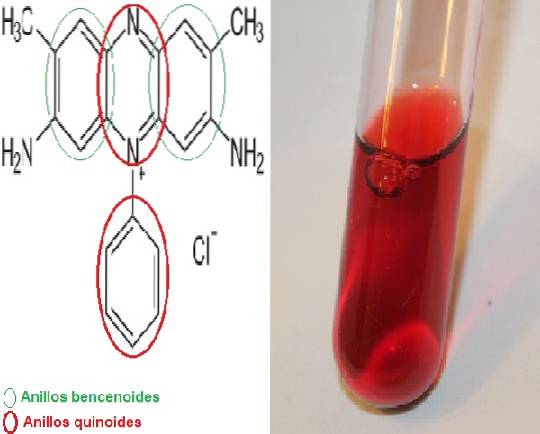

Ci sono diverse disuguaglianze legate alla disuguaglianza di Chebyshov. Uno dei più noti è la disuguaglianza di Markov:

In questa espressione X è una variabile casuale non negativa con k, r> 0.

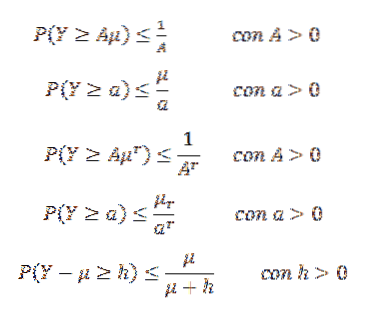

La disuguaglianza di Markov può assumere diverse forme. Ad esempio, sia Y una variabile casuale non negativa (quindi P (Y> = 0) = 1) e supponiamo che E (Y) = μ esista. Supponiamo anche che (E (Y))r= μr esiste per qualche intero r> 1. Poi:

Un'altra disuguaglianza è gaussiana, che ci dice che data una variabile casuale unimodale X con modo a zero, allora per k> 0,

Riferimenti

- Kai Lai Chung. Teoria elementare della proabilità con processi stocastici. Springer-Verlag New York Inc

- Kenneth.H. Rosen Matematica discreta e sue applicazioni. S.A. MCGRAW-HILL / INTERAMERICANA DE ESPAÑA.

- Paul L. Meyer. Probabilità e applicazioni statistiche. S.A. MESSICANO ALHAMBRA.

- Seymour Lipschutz Ph.D. 2000 Problemi risolti di matematica discreta. McGRAW-HILL.

- Seymour Lipschutz Ph.D. Teoria e problemi di probabilità. McGRAW-HILL.

Nessun utente ha ancora commentato questo articolo.